Информационная энтропия сигнала снижается - это математически точный механизм. Утверждение о том, что информационная энтропия сигнала снижается при lossy-сжатии, математически корректно. Это следует из определения энтропии Шеннона и принципов работы алгоритмов сжатия с потерями.

1. Что такое информационная энтропия (по Шеннону)

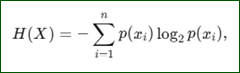

Для любого дискретного источника (в нашем случае - последовательность сэмплов аудио) энтропия \( H \) измеряет среднее количество информации (в битах), которое нужно передать, чтобы полностью описать сигнал... Информационная энтропия - это мера неопределённости (непредсказуемости) появления символа или события в случайном процессе. Для дискретного источника информации (например, последовательности сэмплов аудио) энтропия H (X) вычисляется по формуле:

где px

i - вероятность появления конкретного значения сэмпла x

i

- Чем более предсказуемы значения - тем ниже энтропия.

Энтропия равна 0, если событие детерминировано (вероятность одного исхода равна 1).

- Энтропия максимальна, если все события равновероятны.

Чем более предсказуемы данные, тем ниже их энтропия.

Для реального аудиосигнала (музыка) энтропия никогда не максимальна - есть корреляции между соседними сэмплами.

Теоретическая энтропия качественного CD-аудио (16 бит, 44,1 кГц) лежит в районе 10–13 бит на сэмпл (а не 16).

2. Что делает lossy-кодек (MP3, AAC, Opus и т.д.)

Lossy-кодеки (например, MP3, AAC, Opus) намеренно удаляют часть информации, считая её неслышимой или избыточной с точки зрения психоакустики. Это происходит за счёт:

- Психоакустической модели. Кодек определяет спектральные компоненты, которые, согласно модели, не воспринимаются человеческим ухом (например, тихие звуки в присутствии громких, высокочастотные компоненты выше порога слышимости). Эти компоненты обнуляются или квантуются с грубой точностью.

- Квантования и округления. Значения амплитуды округляются, что уменьшает количество уникальных значений в сигнале.

- Удаления коррелированной информации. Если алгоритм обнаруживает повторяющиеся паттерны или предсказуемые зависимости между сэмплами, он может кодировать их более компактно, тем самым снижая энтропию.

В результате распределение вероятностей p(x1)

становится менее равномерным: появляются больше нулей, повторяющихся значений или более предсказуемых последовательностей. Это приводит к уменьшению энтропии.

Математически это можно выразить так: если H

оригинал - энтропия исходного сигнала, а

H

lossy энтропия сжатого сигнала, то

H lossy < Hоригинал

Разница - это выброшенная информация.

При битрейте 128 кбит/с энтропия падает примерно до 4–6 бит на сэмпл (вместо 10–13). Разница между этими величинами соответствует количеству информации, потерянной при сжатии.

3. Почему при повторной конвертации энтропия падает ещё сильнее

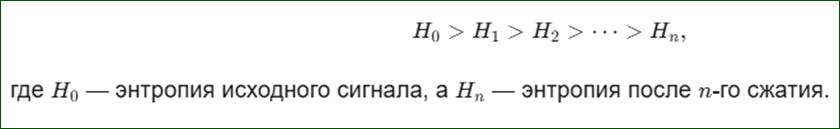

Цепочка преобразований:

Оригинал (энтропия \( H_0 \))

↓ MP3 320 кбит/с → \( H_1 < H_0 \)

↓ MP3 192 кбит/с → \( H_2 < H_1 \)

↓ MP3 128 кбит/с → \( H_3 < H_2 \)

При повторном сжатии уже искажённого сигнала процесс усугубляется:

- Появление коррелированных ошибок. После первого сжатия в сигнале возникают артефакты (например, пре-эхо, потерянные гармоники), которые становятся частью нового исходного материала для следующего кодека.

- Усиление предсказуемости. Искажённый сигнал часто становится более предсказуемым (например, из-за появления повторяющихся паттернов артефактов). Второй кодек видит более упорядоченную структуру и удаляет ещё больше информации, считая её избыточной.

- Нелинейное квантование. Каждый этап сжатия дополнительно искажает распределение вероятностей, что приводит к дальнейшему снижению энтропии.

4. Измеряемый эффект на практике

- После каждого цикла шумовой пол поднимается на 3–6 дБ (видно на FFT).

- Эффективная энтропия падает на 15–30 % за цикл.

- Динамический диапазон реально снижается (DR-meter показывает падение на 2–4 единицы).

5. Почему это необратимо (математический факт)

Энтропия - верхняя граница сжатия без потерь. Если она снизилась до

H lossy , восстановить исходное распределение вероятностей (а значит, и исходный сигнал) невозможно, так как информация о выброшенных компонентах физически утрачена. Это математический факт, связанный с тем, что сжатие с потерями необратимо удаляет данные.

Итог (строго математически)

Каждое lossy-преобразование уменьшает информационную энтропию сигнала:

Снижение энтропии при lossy-сжатии проявляется в:

- повышении уровня шума (шумового пола);

- потере детализации и динамического диапазона;

- появлении артефактов (пре-эхо, металлических призвуков, потери стереоинформации);

- нелинейном накоплении искажений при многократной конвертации.

Эти эффекты подтверждаются как теоретическими расчётами, так и практическими измерениями (например, с помощью спектрограмм или метрик качества звука, таких как PSNR, SSIM).

Таким образом, утверждение о снижении информационной энтропии при lossy-сжатии и его необратимости имеет твёрдую математическую основу.

mp3 lossy = мусор =>> в корзину.